在当今的科技领域,大模型的研究正如火如荼地进行着。然而,对于许多致力于此的研究者来说,却常常面临一个棘手的问题。在研究大模型的过程中,需要访问 huggingface。虽然国内魔塔社区也后很多镜像,但一些国外最新的项目,还是只能在huggingface上找到。

但国内通常无法直接访问,这无疑给众多研究者带来了极大的苦恼。虽然有一些科学上网的方法,但不是限速,就是按流量计费。对于动不动就几十个G数据的大模型来说,真实非常不方便。

不过别担心,今天我就来为大家分享一个国内的镜像网站,为大家的研究之路扫除障碍。

官网: https://hf-mirror.com/

网站域名 hf-mirror.com,用于镜像 huggingface.co 域名。作为一个公益项目,致力于帮助国内AI开发者快速、稳定的下载模型、数据集。

如何使用HF-Mirror?

方法一:直接网页访问

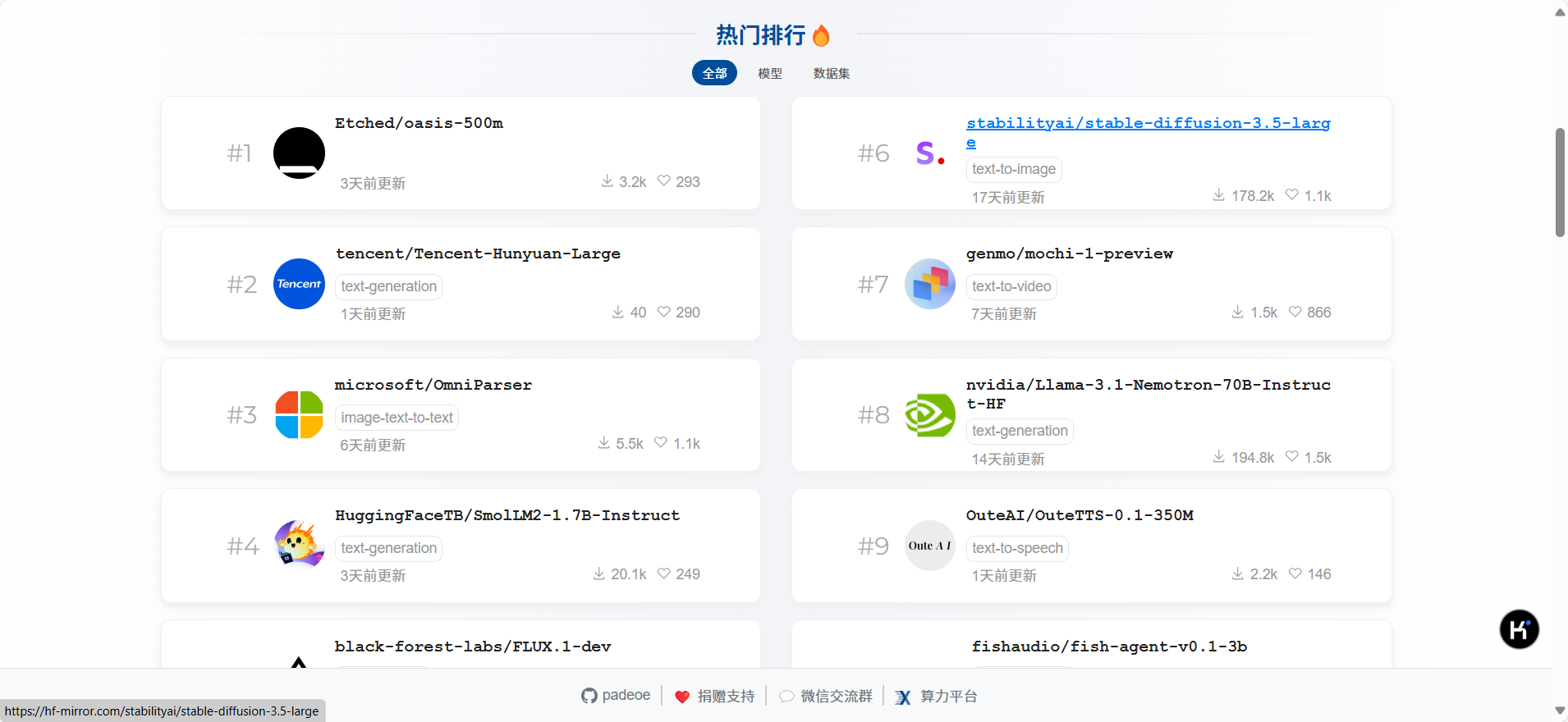

在浏览器中输入https://hf-mirror.com/ 看到顶部搜索框,输入想找的大模型名称,就可以搜索,找到的结果和huggingface的页面一模一样,

# Make sure you have git-lfs installed (https://git-lfs.com)

git lfs install

git clone https://hf-mirror.com/Qwen/Qwen2.5-72B-Instruct我家实测速度可以达到5M/秒

方法二:huggingface-cli

huggingface-cli 是 Hugging Face 官方提供的命令行工具,自带完善的下载功能。

1. 安装依赖

pip install -U huggingface_hub注意:huggingface_hub 依赖于 Python>=3.8,此外需要安装 0.17.0 及以上的版本,推荐0.19.0+。

2. 设置环境变量

Linux

export HF_ENDPOINT=https://hf-mirror.comWindows Powershell

$env:HF_ENDPOINT = "https://hf-mirror.com"建议将上面这一行写入 ~/.bashrc。

3 下载模型和数据集

huggingface-cli download --resume-download gpt2 --local-dir gpt2huggingface-cli download --repo-type dataset --resume-download wikitext --local-dir wikitext值得注意的是,有个--local-dir-use-symlinks False 参数可选,因为huggingface的工具链默认会使用符号链接来存储下载的文件,导致--local-dir指定的目录中都是一些“链接文件”,真实模型则存储在~/.cache/huggingface下,如果不喜欢这个可以用 --local-dir-use-symlinks False取消这个逻辑。

方法三:使用 hfd (推荐)

hfd 是https://hf-mirror.com/开发的 huggingface 专用下载工具,基于成熟工具 git+aria2,可以做到稳定下载不断线。

1. 下载hfd

wget https://hf-mirror.com/hfd/hfd.sh

chmod a+x hfd.sh2. 设置环境变量

HF_ENDPOINT 该变量是 HF 相关库官方支持的一个环境变量,设置后,相关库会尊重该变量指定的主机名,替换 huggingface.co 域名进行模型、数据集的下载和上传,从而做到无需修改python的transformers代码,即可利用上镜像站来加载模型。

设置环境变量同上

./hfd.sh gpt2 ./hfd.sh wikitext --dataset --tool aria2c -x 4更多内容关注https://hf-mirror.com/

评论区